问 AI,随时随地问 AI

动作地址:https://getquicker.net/Sharedaction?code=f1743555-674d-4729-2552-08dd3978d697

一、本动作有3大功能

1. 右键选中文字问ai,随时随地,跨软件

2. 在文本窗口进行多轮会话,可复制和发送到当前窗口

3.在当前窗口(记事本,笔记等)直接多轮对话

二、本动作特色

1. 主打随时随地问,默认不使用多轮对话,类似查询服务

2. 支持众多厂商模型,可以自由选择和添加

3. 多厂商多模型统一历史会话,可对同一问题轮番回答,酷!

4. 智能历史对话管理,仅保留可用历史,无日志残留,提高响应性能,减小资源占用。

什么是统一历史会话?即切换 ai 无影响,比如,第一个问题问豆包,然后切换模型,第二个问题问 deepseek,deeseek 依然知道刚才提了什么及豆包回答了什么,接着,第三个让通义说说吧,第四个,chatgpt,别光观望呀,。。。。。。

使用说明:

AI配置说明:

api_url,注意,quicker默认会在url地址后面添加 v1/chat/completions后缀。一般ai url都会有chat/completions后缀,但v1未必会有。

消除v1的办法,quicker里,chat/completions可以 用{1}代替,有了{1},quicker就不会再显示v1了。

比如,豆包api可以这样写 https://ark.cn-beijing.volces.com/api/v3/{1},实际访问地址是 https://ark.cn-beijing.volces.com/api/v3/chat/completions,消除了v1

quicker的逻辑是,当有{1}时,会用{1}占位,然后用chat/completions替换{1},当没有{1}时,会在url后面添加v1/chat/completions

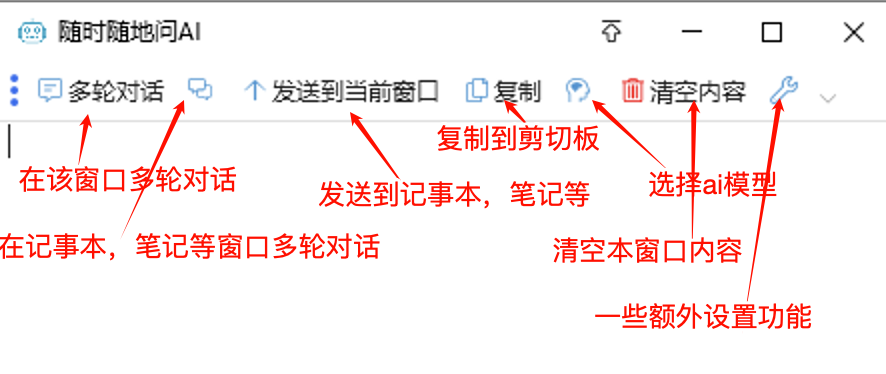

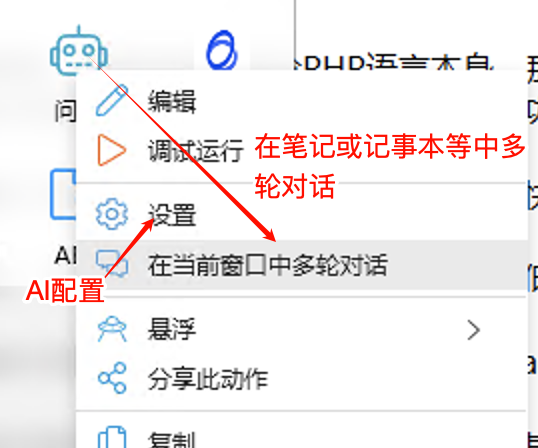

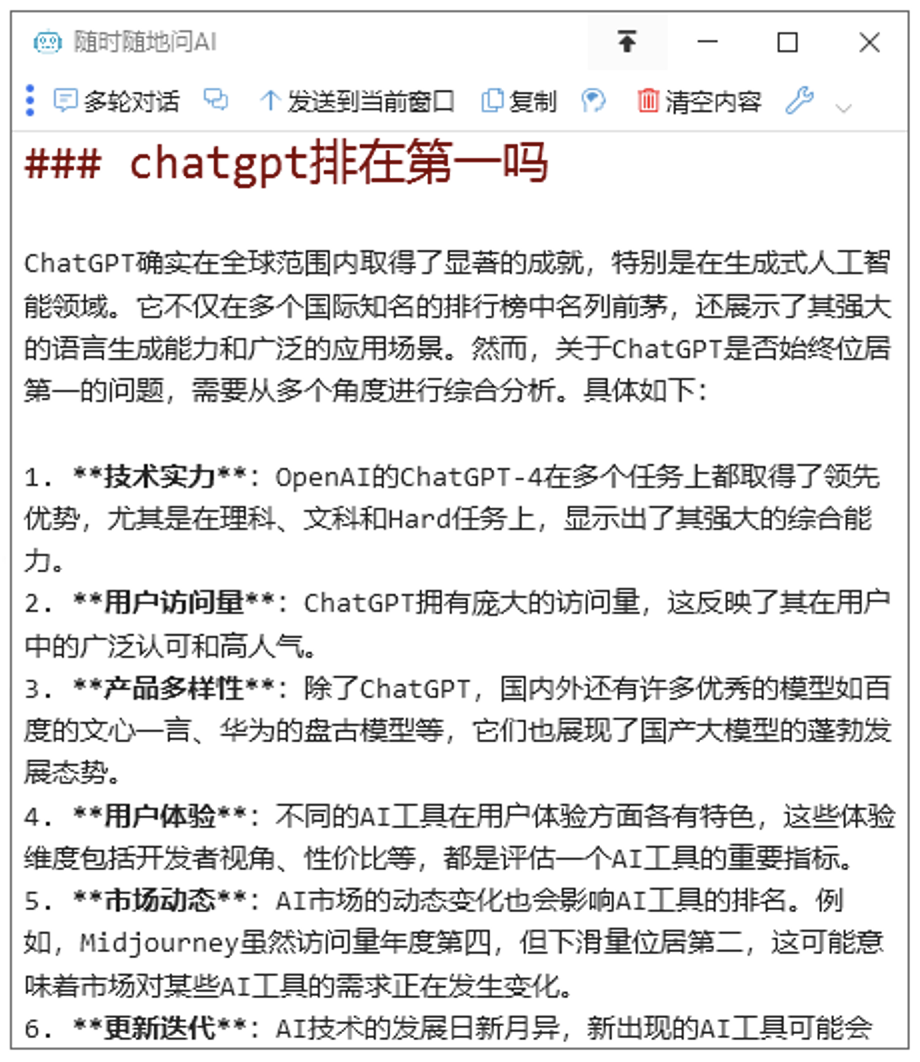

三、截图预览

右键菜单

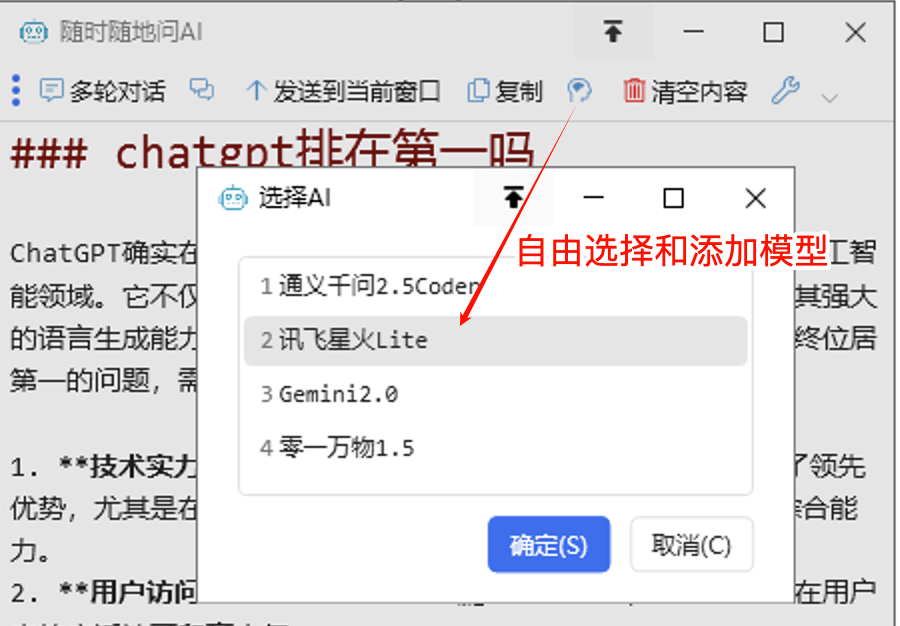

文本窗口中显示对话内容

文本窗口中多轮对话

笔记软件中多轮对话

自由选择和添加模型

四、如何获取免费ai

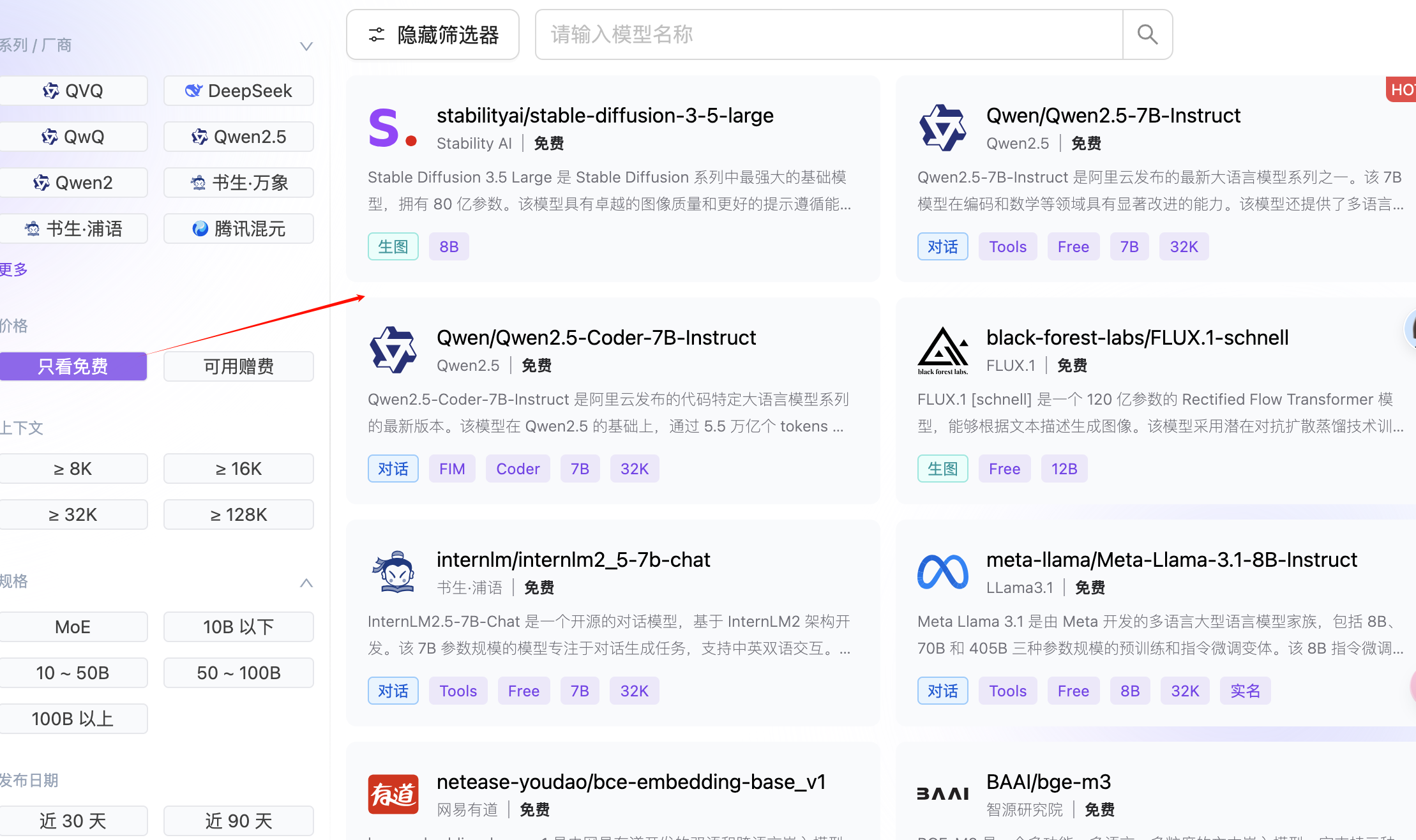

1. 硅基流动

打开 硅基流动ai列表 ,然后选择只看免费

2. 讯飞星火

可参考 https://getquicker.net/Common/Topics/ViewTopic/27784

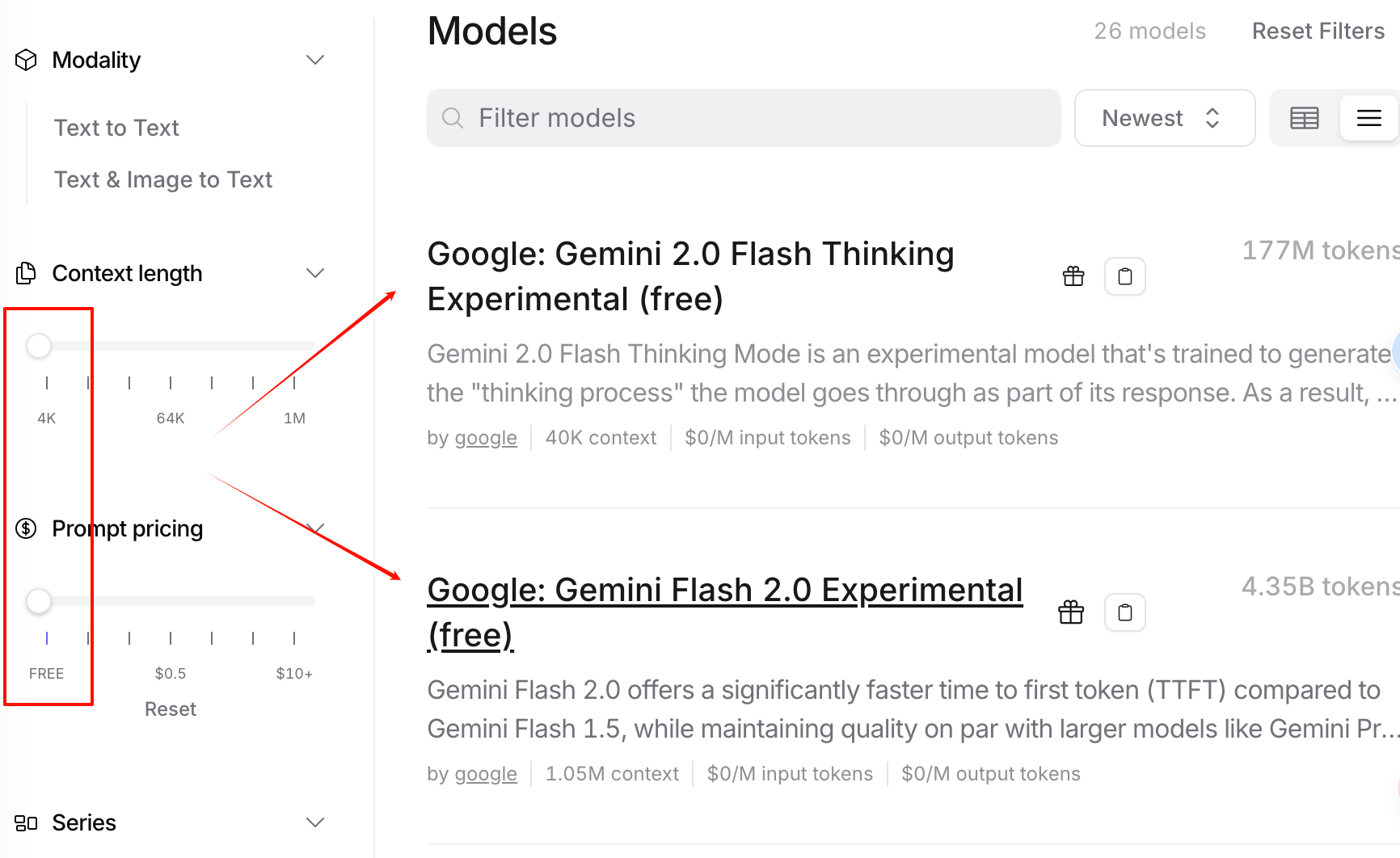

3. openrouter

模型超多,不过少量免费

- 百度千帆大模型

https://console.bce.baidu.com/qianfan/modelcenter/model/buildIn/list 模型列表 左侧选免费

https://cloud.baidu.com/doc/WENXINWORKSHOP/s/Zm2ycv77m#api_key%E8%AF%B4%E6%98%8E 模型 open ai 兼容文档

五、如何获取国外ai

推荐第三方平台 V3API

优点:

模型多,使用标准的OpenAI接口协议访问68+模型,支持ChatGPT(所有模型)、Claude3.5、Gemini、Glm-4等系列最新模型,支持联网、绘画、语音等多种功能。

客户端多,从手机到pc到web都有客户端支持。

价格实惠,性价比高,省心,速度块,不用担心自己实现访问国外模型,导致账号被封风险。

六、省钱技巧

1. 建议常规问题国内模型足矣,推荐deepseek, 通义千问,豆包等

2. 仅在国内模型回答不满意时再考虑使用国外模型,这样能最大程度的省钱

3.尽量每次开启新会话,尽量不要使用历史会话,减少token消耗。

可参考 https://forum-zh.obsidian.md/t/topic/38296

京公网安备 11010502053266号

京公网安备 11010502053266号